介绍RWKV:线性Transformers的兴起和探索替代方案

以下是我在RWKV播客中的一些想法摘要:https://www.latent.space/p/rwkv#details

为什么替代方案很重要?

随着2023年的人工智能革命,Transformer架构目前正处于巅峰。然而,由于人们急于采用成功的Transformer架构,所以会容易忽视可以借鉴的替代品。

作为工程师,我们不应该采取一刀切的方法,对每颗钉子都使用相同的锤子。我们应该在每一个解决方案中找到取舍;否则将会被困在特定平台的限制范围内,同时因不知道有其他选择而感到“幸福”,这可能会使发展一夜回到解放前。

这个问题并不是人工智能领域独有的,而是一种从古到今都在重复的历史模式。

SQL战争历史的一页……

最近软件开发中一个值得注意的例子是,当SQL服务器开始受到物理限制时,便出现了NoSQL的趋势。世界各地的初创企业都出于“规模”的原因转向了NoSQL,尽管它们远未达到这些规模。

然而,随着时间的推移,当最终一致性和NoSQL管理开销的出现,以及硬件功能在SSD速度和容量方面的巨大飞跃, SQL服务器最近又出现了回归的趋势,因为它们使用简单性,并且现在90%以上的初创公司都有足够的可扩展性。

这是否意味着SQL比NoSQL更好,或反之亦然?不,这只是意味着每种技术都有优缺点和学习点的首选用例,这些用例可以在类似技术中交叉传播。

目前Transformer架构最大的痛点是什么?

通常,这包括计算、上下文大小、数据集和对齐。在本次讨论中,我们将重点讨论计算和上下文长度:

- 由于使用/生成的每个令牌的O(N^2)增加而导致的二次计算成本。这使得大于10万的上下文大小非常昂贵,从而影响推理和训练。

- 当前的GPU短缺加剧了这个问题。

- 上下文大小限制了Attention机制,严重限制了“智能代理”用例(如smol-dev),并强制解决问题。较大的上下文需要较少的解决方法。

那么,我们该如何解决这个问题呢?

介绍RWKV:一种线性Transformer/现代大型RNN

RWKV和微软RetNet是第一个被称为“线性Transformer”的新类别。

它通过支持以下内容直接解决了上述三个限制:

- 线性计算成本,与上下文大小无关。

- 在CPU(尤其是ARM)中,允许以更低的要求在RNN模式下输出合理的令牌/秒。

- 没有作为RNN的硬上下文大小限制。文档中的任何限制都是指导原则——您可以对其进行微调。

随着我们不断将人工智能模型扩大到100k及以上的上下文大小,二次方计算成本开始呈指数级增长。

然而,线性Transformer并没有放弃递归神经网络架构及解决其瓶颈,这迫使它们被取代。

不过,重新设计的RNN吸取了Transformer可扩展的经验教训,使RNN能与Transformer工作方式类似,并消除了这些瓶颈。

在训练速度方面,用Transformer让它们重返赛场——允许它们在O(N)成本下高效运行,同时在训练中扩展到10亿个参数以上,同时保持类似的性能水平。

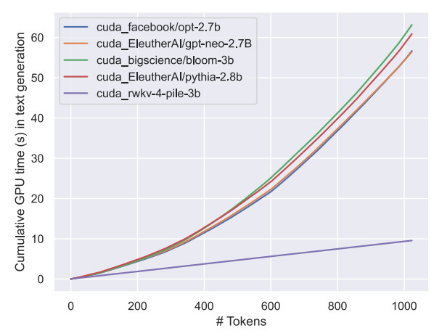

图表:线性Transformer计算成本按每个令牌线性缩放与变换器的指数增长

当你按平方比线性缩放时,你将在2k令牌计数时达到10倍以上,在100k令牌长度时达到100倍以上。

在14B参数下,RWKV是最大的开源线性Transformer,与GPT NeoX和其他类似数据集(如the Pile)不相上下。

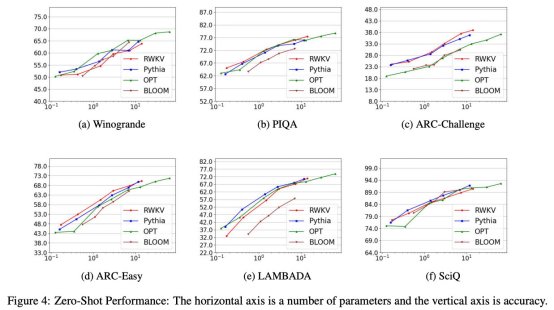

各种基准显示RWKV模型的性能与类似规模的现有变压器模型相当

但用更简单的话来说,这意味着什么?

优点

- 在较大的上下文大小中,推理/训练比Transformer便宜10倍甚至更多

- 在RNN模式下,可以在非常有限的硬件上缓慢运行

- 与相同数据集上的Transformer性能相似

- RNN没有技术上下文大小限制(无限上下文!)

缺点

- 滑动窗口问题,有损内存超过某一点

- 尚未证明可扩展到14B参数以上

- 不如变压器优化和采用

因此,虽然RWKV还没有达到LLaMA2那样的60B+参数规模,但有了正确的支持/资源,它有可能以更低的成本和更大的环境实现这一目标,尤其是在模型趋向于更小、更高效的情况下。

如果效率对您的用例很重要,请考虑它。但这并不是最终的解决方案——健康的替代品仍然是关键。

我们可能应该学习的其他替代方案及其好处

扩散模型:文本训练速度较慢,但对多时期训练具有极高的弹性。找出原因可以帮助缓解令牌危机。

生成对抗性网络/代理:可以在没有数据集的情况下,使用技术将所需的训练集训练到特定目标,即使是基于文本的模型。

原文标题:Introducing RWKV: The Rise of Linear Transformers and Exploring Alternatives,作者:picocreator

https://hackernoon.com/introducing-rwkv-the-rise-of-linear-transformers-and-exploring-alternatives