随着性能差距的持续缩小,越来越多的模型展示出竞争性的结果,这引发了一个问题,即LLMs是否真的开始趋于平稳。如果这一趋势持续下去,它可能对未来语言模型的开发和部署产生重大影响,可能将重点从简单地增加模型大小转移到探索更高效和专业化的架构。

read more

随着性能差距的持续缩小,越来越多的模型展示出竞争性的结果,这引发了一个问题,即LLMs是否真的开始趋于平稳。如果这一趋势持续下去,它可能对未来语言模型的开发和部署产生重大影响,可能将重点从简单地增加模型大小转移到探索更高效和专业化的架构。

read more

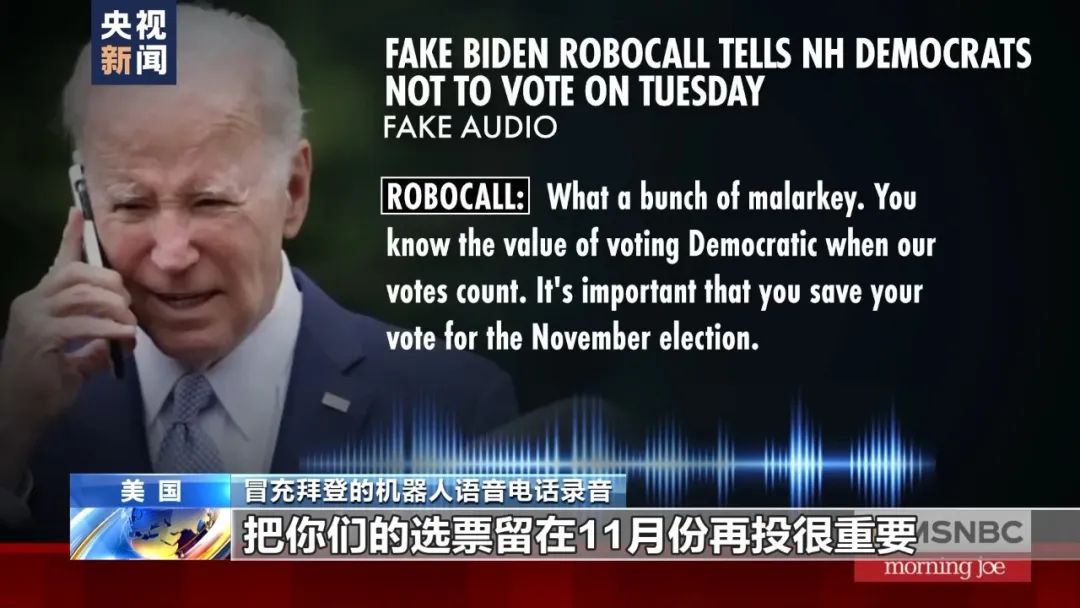

随着总选举的临近,众多科技企业在推出AI系统和大模型时都“拘谨”了不少。这种保守态度并不出人意料,万一有人蓄意利用这些技术进行错误信息传播,甚至对选举流程或成果产生影响,那么必会招致政府的严格监管。

read more

众所周知,诸如MMLU(旨在衡量知识)、ARC(试图衡量技能习得)和DROP(测试模型对文本片段的理解能力)等流行AI基准测试的有效性和实用性尚存争议。但无论好坏,它们仍是AI玩家评估其模型的少数标准化手段之一。

read more

“我们需要提供开源替代品和开源平台,这样那些希望开始投资并了解人工智能如何影响其业务的公司,就可以采用模型,而不必担心数据治理或安全问题,并开始在本地环境中对其进行修改和熟悉。”

read more

本文将探讨使用自组织映射(SOM)算法来提升RAG的LLM上下文的检索性能,并给出具体的示例展示。当今社会,人们使用大量数据训练包含数百万和数十亿模型参数的大型语言模型(LLM),目标是生成文本,如文本完成、文本摘要、语言翻译和回答问题。

read more